Hermès et le Médium – Du messager Divin à l’Hyper-Changement

Hermès, messager divin et préfiguration de l’hyper-changement

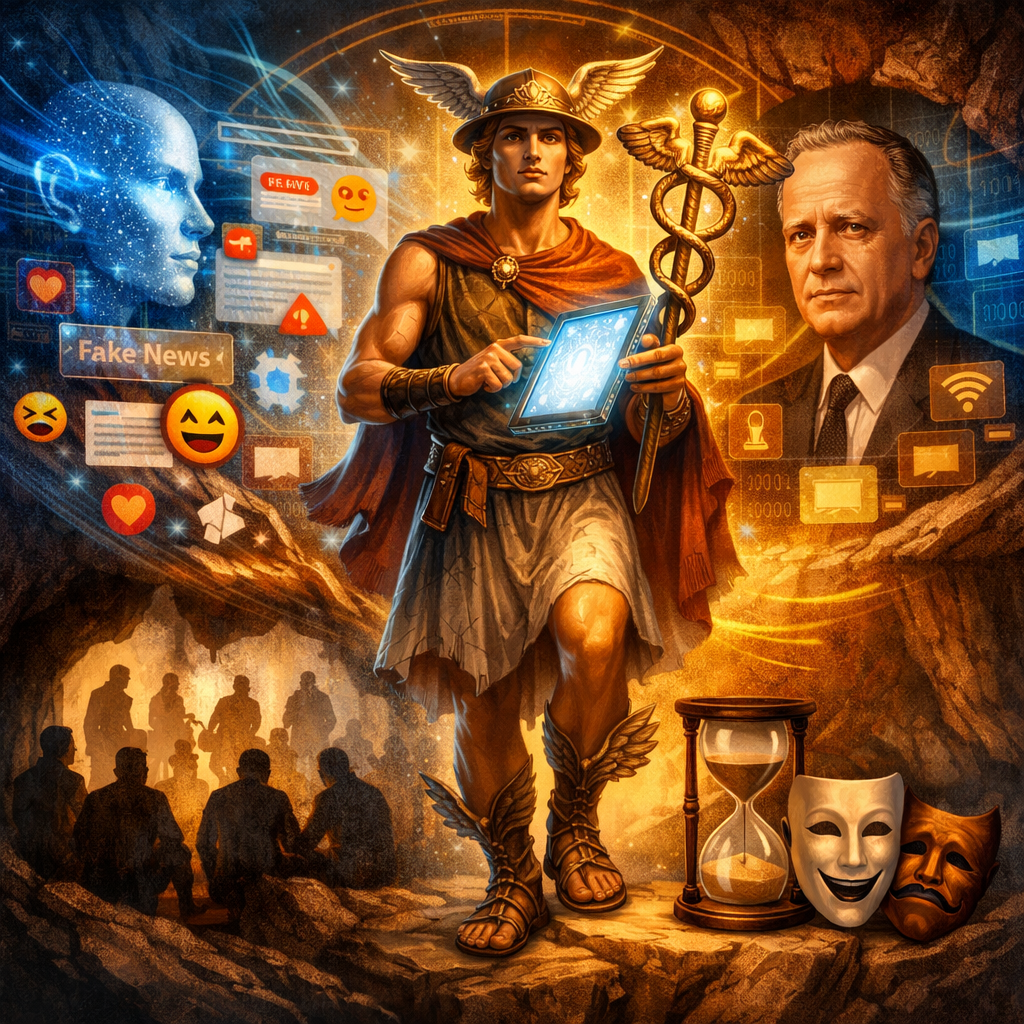

Hermès occupe une place centrale dans la mythologie grecque en tant que messager des dieux olympiens. Fils de Zeus et de la nymphe Maïa, il naît dans une grotte du mont Cyllène et se distingue immédiatement par sa ruse et sa rapidité. Il est chaussé de sandales ailées, coiffé d’un pétase ailé et porte le caducée, cette baguette entourée de deux serpents entrecroisés, symbole d’harmonie et de pouvoir ambivalent. Grâce à ces attributs, il transmet les ordres divins entre l’Olympe, la terre et les Enfers avec une efficacité inégalée. Les textes antiques, notamment l’Hymne homérique à Hermès (VIème siècle B.C.), soulignent sa capacité à franchir instantanément les distances et à reformuler les messages pour les rendre persuasifs.

Le personnage mythologique permet d’aborder une question moderne cruciale : celle de la circulation de l’information et de son action structurante sur les sociétés. Dans l’Antiquité, Hermès adaptait les paroles divines aux mortels en filtrant et en reformulant les propos pour les rendre intelligibles. Aujourd’hui, les technologies numériques jouent un rôle analogue à une échelle inédite. Les réseaux sociaux, les algorithmes d’apprentissage automatique et les intelligences artificielles génératives ne transportent pas seulement des données, ils les modèlent, les amplifient et les personnalisent selon des logiques invisibles. Cette continuité entre le caducée antique et les data centers contemporains invite à repenser la communication : elle n’est pas un flux neutre, mais une force active qui transforme la réception autant que le message lui-même.

L’information antique voyageait par la parole d’Hermès, limitée par la vitesse humaine et la mémoire orale. L’hyper-changement numérique accélère cette circulation de manière exponentielle avec des milliards de publications quotidiennes. Les fausses informations virales exploitent cette vitesse, car une rumeur se propage six fois plus rapidement qu’un fait vérifié sur les plateformes comme X (anciennement Twitter), selon l’étude fondatrice de Vosoughi, Roy et Aral publiée dans Science en 2018. Ce phénomène polarise les opinions et érode la confiance collective. Hermès le rusé préfigure cette ambiguïté fondamentale : il est à la fois protecteur et trompeur, médium qui révèle et qui déforme, anticipant l’ambivalence des technologies contemporaines.

Hermès, figure du passage : de la grotte de Cyllène au franchisseur de frontières ontologiques

Hermès naît dans l’ombre d’une grotte au mont Cyllène, en Arcadie. À peine sorti du sein maternel, le nouveau-né se lève et parvient au troupeau sacré d’Apollon endormi dans la Piérie (Un des 74 districts régionaux de Grèce, situé dans la partie méridionale de la Macédoine-Centrale, dans la province historique de Macédoine). Avec une ruse prodigieuse, il sacrifie deux bœufs, tend leurs boyaux sur une carapace de tortue pour inventer la lyre, puis inverse les traces des bêtes volées avec des branches de tamaris afin d’effacer son passage. Confronté par Apollon, le nourrisson joue de son instrument une mélodie envoûtante qui désarme la colère divine. Apollon échange alors le troupeau contre la lyre et lui offre le caducée en signe d’harmonie restaurée, marquant ainsi la naissance de la communication comme « art de la médiation ». Hermès incarne ainsi l’idée que communiquer est un art actif de transformation et de pont, pas un transport passif de données.

Zeus envoie Hermès aux Enfers comme négociateur afin de persuader Hadès de libérer Perséphone et la rendre à sa mère après son enlèvement. Dans l’Iliade, Hermès intercède auprès d’Achille pour Priam et le persuade de restituer le corps d’Hector par une parole douce qui flatte l’honneur du héros. En tant que psychopompe, il conduit les âmes des défunts au Styx sans jamais porter de jugement moral, assurant le passage sans distinction éthique. C’est ainsi qu’il accompagne Eurydice vers les Enfers après sa mort, ou ramène son âme aux Enfers après que Orphée se soit retourné. Cette mobilité marque Hermès comme le franchisseur de toutes les frontières : entre divins et mortels, vivants et morts, vérité et mensonge. Aux carrefours, les Grecs érigent des « hermaï », des bustes à quatre faces, pour implorer sa protection lors des choix périlleux. Dieu des voyageurs, il préserve les marchands et les pèlerins. Sa ruse natale se double d’une ambiguïté fertile : il trompe pour révéler et persuade pour pacifier.

Hermès incarne la circulation entre les mondes. Il unit l’Olympe à la terre et les vivants aux morts. Il est l’intermédiaire actif dont les sandales ailées abolissent l’espace. Dans l’Odyssée, chaque mission montre sa puissance de reformulation. Le messager n’est pas un simple vecteur passif, il transforme le message autant qu’il le transporte. Il n’offre pas un compte rendu mot pour mot des ordres divins, il les adapte par l’éloquence selon le destinataire. Devant Achille, il flatte l’honneur du héros pour obtenir la paix. Cette transformation fait de lui un médium originel dont la langue enchante et modifie la réception, anticipant la thèse selon laquelle le canal détermine l’impact plus que le contenu brut.

McLuhan : « le médium est le message » comme principe structurant

Harold Innis, professeur à l’Université de Toronto, montre que les technologies de communication (rouleau de papyrus, presse, câble, radio, etc.) sont au cœur des grandes transformations historiques et de la montée et la chute des empires. Son élève, Marshall McLuhan, reprend cette idée selon laquelle les médias ne sont pas seulement des outils neutres, mais des acteurs majeurs de l’évolution des sociétés, ce qui lui permet de construire une « histoire des médias » au lieu d’une simple histoire des idées. McLuhan publie en 1964 Understanding Media: The Extensions of Man (Pour comprendre les médias : les prolongements technologiques de l’homme). Sa thèse centrale s’énonce par la formule célèbre : « le médium est le message ». L’effet principal d’une communication réside dans le médium lui-même, non dans le contenu transmis. Le canal modifie les perceptions, les rythmes temporels et les structures sociales plus profondément que les mots véhiculés. McLuhan rejette l’idée d’une neutralité technique, car chaque média agit comme un environnement qui reconfigure les sens humains et les rapports sociaux.

Il définit les médias comme des prolongements technologiques des sens. La roue étend le pied, le livre la vue et le téléphone l’oreille. Ces extensions créent un changement d’échelle en amplifiant une capacité humaine, ce qui modifie la perception globale du monde et l’organisation collective. L’imprimerie favorise l’individualisme, la linéarité et la pensée rationnelle tablée sur l’alignement visuel. La télévision restaure une tribalité auditive où l’émotion et l’image instantanée priment sur l’analyse séquentielle. Les outils façonnent les utilisateurs en retour, souvent de manière inconsciente. Eric McLuhan, fils et collaborateur de Marshall, précise que les technologies opèrent souvent sans que leurs effets soient immédiatement perçus, agissant comme des environnements invisibles.

L’hyper-changement actuel accélère cette dynamique : les algorithmes auto-évoluent et remodèlent l’identité humaine par personnalisation constante. Cette vision s’accorde avec Hermès. Comme les sandales ailées prolongent sa vitesse, les technologies étendent les capacités humaines mais modifient simultanément la perception. Hermès reformule les ordres par ruse, ce qui transforme leur impact sur le destinataire. Le caducée préfigure les effets ambivalents des médias : outil de guérison et de poison selon l’usage. McLuhan distingue le contenu explicite de la forme structurelle. Le contenu est souvent un leurre distrayant pour l’esprit, un appât qui masque les transformations profondes de la forme. La forme détermine les rapports sensoriels, comme le visuel dominant pour le livre imprimée. Cette primauté rejoint la pensée rhétorique de Montaigne : la manière de dire compte davantage que la teneur objective. La structure médiatique conditionne la réception plus que la vérité brute : principe fondamental pour comprendre l’ère des fake news.

Shannon et McLuhan : deux modèles de communication, deux visions du monde

Internet accélère et démocratise ce phénomène de manière structurelle. Avant 1990, la désinformation exigeait des ressources importantes : imprimerie, radio, télévision. Aujourd’hui, le coût marginal est nul et la portée globale instantanée. La rumeur orale devient un post sur les réseaux sociaux, copiable à l’infini. La différence réside dans la répétition algorithmique qui forge des vérités parallèles en boucle de rétroaction. Le faux prospère là où l’émotion l’emporte, mais le numérique en fait une épidémie systémique par sélection évolutionnaire des contenus les plus viraux.

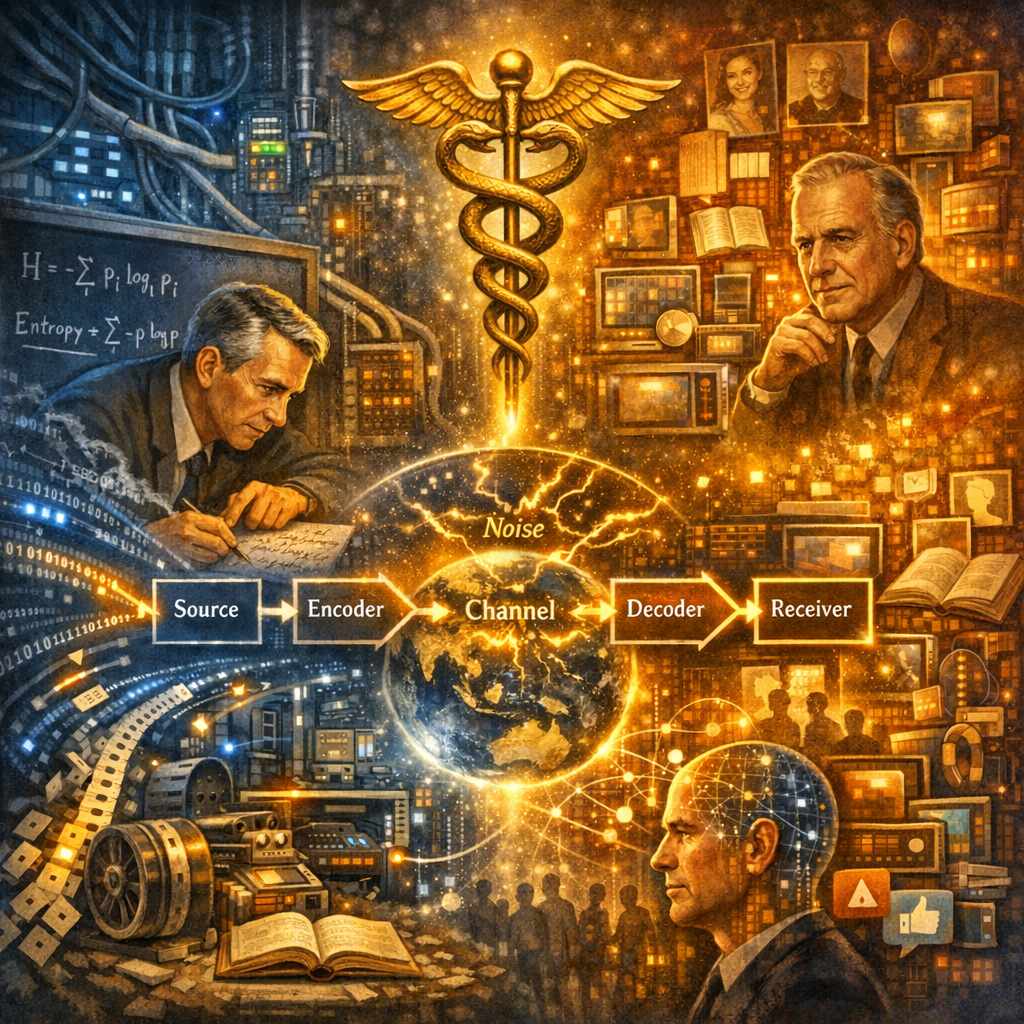

Claude Shannon publie, en 1948, « A Mathematical Theory of Communication » (Une théorie mathématique de la communication). Ce cadre modélise la communication comme un processus technique linéaire et déterministe. Une source génère un message, encodé en signal, transmis via un canal sujet au bruit, puis décodé par le récepteur. L’information se mesure en bits via l’entropie, qui quantifie l’incertitude. Les théorèmes de Shannon optimisent la compression et la transmission fiable malgré les perturbations, fondant ainsi l’ingénierie des télécommunications modernes.

Shannon vise l’efficacité technique pure et ignore délibérément le sens sémantique. Un message politique vaut autant qu’une suite aléatoire de bits si le débit reste sous la capacité du canal. Ce modèle traite l’humain comme un récepteur passif sans rétroaction ni interprétation subjective. Un signal transmet une information sans juger son impact social, émotionnel ou politique. Cette neutralité mathématique fonde le numérique moderne, mais ignore fondamentalement comment le canal modèle la réception humaine, la propagation culturelle ou la transformation identitaire.

McLuhan opère un virage radical car sa théorie est transformationnelle et anthropologique. Là où Shannon mesure le débit d’information, McLuhan interroge l’effet du médium sur la culture et l’identité collective. Le canal restructure les sens via un changement d’échelle qui déplace l’équilibre sensoriel. Shannon optimise la transmission technique ; McLuhan révèle la transformation humaine. Ce glissement éclaire l’ère numérique où les algorithmes dépassent le bit pour façonner des réalités culturelles et politiques. Là où Shannon voit un canal neutre, McLuhan voit un environnement actif qui crée de nouvelles formes de tribalité, comme les réseaux sociaux aujourd’hui.

Pourquoi McLuhan éclaire mieux les fake news : la forme prime sur le fond dans l’écosystème numérique

Les fake news prolifèrent précisément là où la forme prime sur le fond. La vitesse de diffusion et la primauté de l’affect créent un écosystème où la véracité importe moins que l’impact émotionnel et viral. Le médium numérique rend l’information addictive et favorise le sensationnalisme par conception architecturale. Les plateformes sélectionnent les contenus par l’engagement (likes, partages, temps de visionnage), où le faux surpasse systématiquement le vrai en viralité.

Les chercheurs du MIT, Soroush Vosoughi, Deb Roy et Sinan Aral, ont analysé 126 000 nouvelles diffusées sur Twitter entre 2006 et 2017, correspondant à environ 4,6 millions de tweets partagés par 3 millions de personnes. Ils ont fait valider la véracité de chaque information par six organisations de fact-checking indépendantes (PolitiFact, FactCheck.org, Snopes, etc.).

Leur méthodologie permet de comparer objectivement la vitesse de propagation des fausses nouvelles versus les vraies.

| Mesure | Faux vs Vrai | Explication |

| Vitesse de propagation | 6 fois plus rapide | Les fausses nouvelles diffusent six fois plus vite que les vraies pour atteindre 1500 personnes |

| Profondeur de cascade | Plus profondes | Les cascades de fausses nouvelles atteignent 19-30% de profondeur supplémentaire |

| Taille de cascade | Plus grandes | Les fausses nouvelles parviennent à un plus grand nombre d’utilisateurs uniques |

| Probabilité de diffusion | 70% plus élevée | Un tweet faux a 70% plus de probabilité d’être retweeté qu’un tweet vrai |

L’étude montre que la probabilité qu’une fausse nouvelle soit retweetée est de 70% supérieure à celle d’une vraie nouvelle. Les cascade (chaînes de partages) partant de fausses informations atteignent systématiquement plus de monde, plus vite.

Pourquoi le faux gagne-t-il ?

Les chercheurs identifient trois mécanismes principaux :

1. La nouveauté : Les fausses nouvelles sont statistiquement plus « nouvelles » que les vraies. Elles contiennent des informations jamais vues, ce qui stimule la curiosité et le partage. Le vrai est souvent une confirmation de connaissances existantes, donc moins excitant.

2. L’émotion : Les fausses nouvelles évoquent plus d’émotions fortes (peur, dégoût, surprise, colère) que les vraies. Le cerveau humain est programmé pour réagir viscéralement à ces émotions par le Système 1 de Kahneman. L’anxiété, l’indignation et la surprise déclenchent un partage réflexe avant réflexion critique.

3. Le biais de confirmation : Les fausses nouvelles confirment souvent des préjugés préexistants ou des théories complotistes déjà circulant dans les bulles de filtres. Le partage devient un acte d’appartenance groupale (biais Asch) et non une évaluation factuelle.

L’une des découvertes cruciales : les humains propagent plus que les bots. Contre-intuitivement, les chercheurs ont démontré que même après avoir retiré tous les robots identifiables (comptes automatisés), l’écart persistait : les humains partagent encore 6x plus vite les fausses nouvelles. Cela valide que ce n’est pas un problème purement technologique mais cognitif et psychologique.

Le biais du faux varie selon les thématiques :

| Catégorie | Écart Faux/Vrai | Explication |

| Politique | Le plus élevé (7x) | La politique polarise, les fausses nouvelles confirment les biais partisans |

| Terrorisme | Élevé (6x) | La peur et l’indignation stimulent le partage émotionnel |

| Sciences | Moyen (4x) | Le faux scientifique semble crédible aux non-experts (effet Dunning-Kruger) |

| Économie | Moyen (4x) | L’anxiété financière pousse au partage rapide |

| Catastrophes | Élevé (5x) | Le drame et l’urgence court-circuitent la vérification |

L’imprimerie exigeait des efforts matériels de vérification (coût du papier, des imprimeurs, des correcteurs), alors que les réseaux sociaux court-circuitent le discernement par friction nulle.

McLuhan distingue les médias « chauds » comme le cinéma ou la radio, qui laissent peu de place à l’ambiguïté car l’information est dense et saturée, des médias « froids » comme le téléphone ou le SMS, qui exigent une participation active pour compléter le message fragmenté. Les réseaux sociaux penchent vers le « froid » par leur fragmentation, leur défilement sans fin et leur incertitude structurelle.

Il n’y a pas de fin naturelle de lecture, contrairement à un livre qui a une dernière page, pas de rythme imposé, contrairement à un film de 2 heures et l’utilisateur choisit constamment de continuer ou d’arrêter, de cliquer ou de passer. Cette absence de structure narrative fermée rend le média « froid » car l’utilisateur doit décider ce qu’il veut voir, doit interpréter chaque nouveau contenu sans repères stables, entraînant une incertitude permanente : qu’est-ce qui va apparaître au prochain scroll ? McLuhan aurait appelé cela un environnement non-linéaire où la participation est constante.

L’utilisateur projette ainsi ses préjugés dans les lacunes de l’information, comblant les vides par des croyances préexistantes que l’on cherche inconsciemment à valider par ses actions ou interprétations . Une fake news devient participative, car l’utilisateur la complète par une confirmation biaisée et la partage comme acte d’appartenance groupale. La ruse herméenne se manifeste par cette accélération qui déforme le message original en le traversant : chaque relais transforme le sens, amplifiant l’émotion au détriment de la vérification.

Histoire des fakes news : de la rumeur antique à l’épidémie algorithmique

Les fausses nouvelles sont un phénomène récurrent amplifié par les mutations technologiques, mais non créé par elles. Dans l’Antiquité, des rumeurs visaient à déstabiliser les pouvoirs à Athènes, comme les accusations d’impiété contre Socrate. Sun Tzu, dans L’Art de la guerre (VIème siècle B.C.), théorise la désinformation comme une arme stratégique suprême : « Toutes les guerres sont fondées sur le mensonge ». Au Moyen Âge, des accusations imaginaires de violence rituelle servaient à justifier des persécutions antisémites. La propagande s’organise avec l’État moderne : au XVIème siècle, les libelles permettent d’attaquer les puissants sous l’anonymat. Le XVIIème siècle voit les mazarinades ridiculiser le cardinal Mazarin pour galvaniser la révolte de la Fronde.

Pendant les Lumières, Voltaire orchestre des rumeurs pour discréditer l’absolutisme et l’intolérance religieuse. La Révolution française marque une apogée de la presse d’opinion violente : Le Père Duchesne d’Hébert excite les masses par un langage cru. Les guerres industrielles institutionnalisent ensuite la désinformation. En 1914, la censure orchestre le « bourrage de crâne » pour maintenir le moral. La Seconde Guerre mondiale perfectionne le concept du « gros mensonge » énoncé par Goebbels : un mensonge suffisamment colossal pour être cru. Durant la Guerre froide, la propagande devient grise (Source délibérément ambiguë, on ne sait pas qui parle vraiment, impossible à attribuer clairement) avec des accusations de génocides bactériologiques américains en Corée, opérant par négation plausible. La négation plausible signifie que les accusateurs peuvent toujours nier qu’ils sont à l’origine de ces accusations s’ils sont démentis, ils laissent planer le doute sans s’engager officiellement et en cas de déni de l’adversaire, ils peuvent toujours dire qu’ils n’ont rien affirmé et qu’ils n’ont fait que relayer des rumeurs qui circulent.

Internet accélère et démocratise ce phénomène de manière structurelle. Avant 1990, la désinformation exigeait des ressources importantes : imprimerie, radio, télévision. Aujourd’hui, le coût marginal est nul et la portée globale instantanée. La rumeur orale devient un post sur les réseaux sociaux, copiable à l’infini. La différence réside dans la répétition algorithmique qui forge des vérités parallèles en boucle de rétroaction. Le faux prospère là où l’émotion l’emporte, mais le numérique en fait une épidémie systémique par sélection évolutionnaire des contenus les plus viraux.

Pourquoi le cerveau y adhère : les mécanismes cognitifs, de Kahneman à Dunning-Kruger

L’adhésion aux fake news repose sur des processus biologiques et cognitifs ancestraux que le numérique exploite avec une précision inédite. Daniel Kahneman et Amos Tversky distinguent deux modes de pensée : le « Système 1 », rapide, intuitif et automatique, versus le « Système 2 », lent, logique et énergivore. Pour économiser l’énergie métabolique du cerveau – qui consomme 20% du glucose corporel pour 2% de la masse – le Système 1 prédomine dans les situations quotidiennes. Ce principe d’économie cognitive favorise l’acceptation immédiate de récits simples et émotionnels, entravant l’effort de vérification.

La répétition renforce cette vulnérabilité via l’effet de vérité illusoire. Lisa Fazio démontre que l’exposition répétée à une information augmente sa probabilité d’être jugée vraie, même si l’individu connaît la réfutation. Ce phénomène provient de la fluidité cognitive : le cerveau interprète l’aisance de traitement (fluidité cognitive – processing fluency) comme un signal de vérité. Les algorithmes enferment ainsi l’utilisateur dans des boucles de répétition familières, transformant la familiarité en crédibilité. Sur le plan biologique, les contenus viraux activent l’amygdale, liée aux réactions de survie. Les neurosciences démontrent que cette activation court-circuite le cortex préfrontal, siège du raisonnement et du contrôle cognitif. L’émotion forte déclenche une réaction viscérale avant toute analyse critique, créant une empreinte mnésique durable même si le fait est ultérieurement réfuté.

Le cerveau est également optimisé pour la survie sociale et la cohésion de groupe. Solomon Asch montre que l’individu peut nier l’évidence visuelle pour s’aligner sur l’opacité de son groupe, par pression normative. Partager une information devient un signal d’appartenance, plus important que son exactitude factuelle. Le biais de confirmation (Nickerson, 1998) filtre les données pour protéger la cohérence de l’identité du clan, rejetant les informations dissonantes. Susan Blackmore propose la théorie des mèmes : les idées sont des réplicateurs culturels soumis à la sélection évolutionnaire, analogues aux gènes (Dawkins, 1976). Les fake news possèdent une fitness (valeur sélective) mémétique supérieure car elles sont mémorables, émotionnelles et contagieuses. L’être humain devient le vecteur passif de mèmes optimisés pour la réplication plutôt que pour l’exactitude. Le terme « Fitness mémétique » indique la capacité d’un mème à se transmettre, se copier et se répandre dans une population..

L’effet Dunning-Kruger s’insère naturellement dans ce réseau de biais. Kruger et Dunning démontrent que les individus les moins compétents dans un domaine surestiment systématiquement leurs capacités, faute de métacognition pour évaluer leurs propres limites. Inversement, les experts sous-estiment leur compétence, pensant que ce qui leur semble évident l’est pour tous.

Dans le contexte des fake news, cet excès de confiance se manifeste de trois manières :

(1) dans la création, les novices auto-perçus comme experts génèrent des contenus simplistes et virals avec une confiance débordante, persuadés de leur véracité (ex. : théories complotistes COVID) ;

(2) dans la propagation, la chambre d’écho valide l’illusion de compétence superficielle : un article partagé 10 000 fois semble par cette « preuve sociale » acquis à la vérité, renforçant la croyance en son propre discernement ;

(3) dans la croyance, la métacognition défaillante empêche l’individu de reconnaître qu’il ne possède pas les outils pour vérifier l’information.

La fluidité cognitive combinée à l’excès de confiance crée une « madeleine de Proust cognitive » : le rappel familiarisant renforce l’adhésion. L’étude de Pennycook & Rand montre que la susceptibilité aux fake news est davantage due à la paresse cognitive (défaut de raisonnement analytique) qu’au biais partisan. Ceux qui oublient le CRT (Test de réflexion cognitive) ont un ratio plus faible entre Système 2 et Système 1, et un excès de confiance dans leurs jugements intuitifs. Les moins compétents ne vérifient pas leurs propres limites par manque d’effort analytique. Cette étude est cruciale car elle remet en cause l’idée reçue que les fake news prospèrent uniquement par biais partisan. Le vrai problème est cognitif : le manque d’activation du Système 2 (pensée analytique).

Howard Bloom radicalise cette analyse en introduisant le « Principe de Lucifer ». Dans son ouvrage « The Lucifer Principle: A Scientific Expedition Into the Forces of History », Bloom transfère la sélection darwinienne du niveau individuel au niveau des groupes sociaux : les nations, partis, tribus, clans sont des « super-organismes » en compétition évolutionnaire. Au sein de ces super-organismes, le mensonge sert de levier de pouvoir stratégiques. Celui qui détiens un « savoir caché » (même faux) acquiert un statut d’initié, un avantage hiérarchique dans la structure groupale. Partager une fausse nouvelle exclusive (Par exemple : « Je sais quelque chose que vous ignorez : les vaccins contiennent des puces 5G ») génère un sentiment de supériorité épistémique, un pouvoir social immédiat. Le mensonge n’est pas un accident cognitif, c’est une stratégie évolutionnaire de domination interne aux groupes. Bloom montre que la ruse triomphe de la raison parce qu’elle est plus contagieuse, plus émotionnelle, plus séductrice. Dans la compétition évolutionnaire entre super-organismes, le groupe qui trompe mieux survit mieux.

L’Hermès tricheur mythologique incarne parfaitement ce Principe de Lucifer. Hermès n’est pas seulement le messager divin, c’est aussi le voleur de bœufs à peine né, le menteur qui persuade Apollon par la lyre, le dieu ambivalent de la vérité et du mensonge. Cette dualité herméenne préfigure la ruse évolutionnaire : la séduction transgressive triomphe de la raison car elle exploite les failles du Système 1 plus efficacement. La transgression ajoute un effet que Kahneman décrit indirectement via le biais de saillance : ce qui viole la norme capte l’attention de façon disproportionnée. La séduction transgressive est donc doublement efficace – elle attire et désarme. Le mensonge est l’arme du super-organisme qui veut dominer son concurrent, l’information exclusive qui hiérarchise le groupe interne. Bloom montre ainsi que les fake news ne sont pas le produit d’un cerveau défaillant, mais d’un cerveau optimisé pour la compétition groupale ancestrale qui se heurte à un hyper-médium numérique. Le cerveau n’est pas en panne : il est vulnérable parce que ses biais ancestraux, autrefois adaptatifs, sont désormais amplifiés par sélection algorithmique. Les algorithmes ne créent pas ces biais — ils les sélectionnent et amplifient comme un environnement évolutionnaire moderne qui favorise certains traits (émotionnels, simples, viraux) au détriment d’autres (complexes, vérifiés, modérés). Bloom insiste : la solution ne réside pas dans l’élimination des biais – biologiquement impossible car ancrée dans l’amygdale et optimisée par 2 millions d’années d’évolution – mais dans l’éducation critique permettant d’activer temporairement le Système 2. Les pauses de vérification, la lecture de trois sources indépendantes, l’entraînement aux techniques de fact-checking sont des contre-stratégies culturelles pour compenser les optima biologiques. Comme un super-organisme doit contrôler le cancer (cellules qui trompent le corps), la société doit contrôler les fake news (cellules informationnelles qui trompent le corps social) par des normes sociales de vérification et une éducation méta-cognitive dès l’enfance.

Intelligence Artificielle et surmultiplication : l’hyper-Hermès génératif institue l’ère du réalisme indiscernable

L’intelligence artificielle générative provoque un changement d’échelle majeur dans la production de la désinformation. Nous passons d’une fabrication artisanale à une multiplication industrielle de contenus, bien que faux, présentant un réalisme saisissant. Des modèles de langage comme GPT-4o ou Grok produisent des textes cohérents en quelques secondes, imitant le ton journalistique de Le Monde ou du New York Times. En parallèle, Midjourney et DALL-E génèrent des images photoréalistes de scènes fictives (manifestations, catastrophes), tandis que Sora ou Runway ML fabriquent des vidéos hyper-truquées que l’œil nu ne parvient plus à détecter. Le service ElevenLabs clône des voix avec une fidélité de 95% après seulement trente secondes d’échantillonnage.

Le chiffre clé de « 80% d’erreurs ChatGPT » reste incertain : certaines études contradictoires varient entre 30 % et 60% selon les questions orientées. En revanche, la baisse des coûts est avérée : avant 2022, une vidéo truquée coûtait 5 000 $ en studio ; aujourd’hui, HeyGen propose ce service pour 5-20 $. Cette effondrement démocratise la diffusion industrielle. Une Intelligence Artificielle en génère 10 000 unités/jour adaptées au contexte, contre une dizaine de libelles pour un humain au XVIIème siècle. La puissance de calcul élimine les barrières économiques et techniques.

L’intelligence artificielle modifie l’échelle de la communication en synthétisant tous les formats textuels, visuels, audio et vidéos. Stable Diffusion crée des scènes inexistantes, comme des manifestations fictives d’un million de pixels en cinq secondes. Le clonage vocal permet de falsifier des discours entiers. Les vidéos de dirigeants atteignent 99% de réalisme avec une synchronisation labiale parfaite. L’Intelligence Artificielle ne se contente plus de copier : elle invente des univers entiers et personnalisés via l’extraction automatisée des données utilisateurs (web scraping). Un message simulant la détresse d’un proche, envoyé de manière isolée, atteint un taux de crédibilité de 90%. Les modèles optimaux par apprentissage par rétroaction humaine (RLHF) poussent la persuasion à son paroxysme en exploitant la peur, laquelle multiplie la viralité par six. La vérification devient alors quasiment impossible : les signatures numériques sont contournables et les outils de détection ne surpassent pas 70% de fiabilité.

Technopolitique et état algorithmique.

Dans ses ouvrages ; « Technopolitique » et « Cyberpunk : Le nouveau système totalitaire », Asma Mhalla théorise un pouvoir hybride fusionnant géants technologiques (X/Twitter, Meta, Musk) et conservatisme étatique. L’Intelligence Artificielle devient un super-Hermès numérisé qui ne transmet plus l’information, mais construit des réalités parallèles personnalisées. Elle renforce et complète la théorie mémétique de Blackmore : l’Intelligence Artificielle devient un mécanisme de propagande étatique auto-renforçant, transformant les citoyens en « soldats » inconscients via les bulles de filtres. Contrairement à l’hypothèse de McLuhan selon laquelle le numérique étend les capacités humaines, Asma Mhalla montre qu’il soumet l’humain à une politisation cyberpunk où algorithmes et États coconstruisent un « totalitarisme doux » : consentement par addiction algorithmique, surveillance par collecte de données, persuasion par personnalisation massive.

En 2025, environ 50-60% des contenus web sont déjà générés par des machines. Cette proportion continuera de croître dans les années à venir, avec l’avènement de l’Intelligence Artificielle multimodale. Les États exploitent massivement ces outils : la Russie déploie des réseaux de bots pour influencer les élections européennes, la Chine produit un million de contenus truqués par jour. Les entreprises sont également ciblées : de fausses informations sur la sécurité des produits peuvent détruire des ventes en quelques heures. En 2025, le Forum Économique Mondial classe la désinformation parmi les risques mondiaux majeurs. Dans un contexte où presque toutes les vidéos semblent authentiques, un scepticisme généralisé s’installe, paralysant le débat public et érodant la confiance collective. Un sondage indique 68% d’Américains doutent de toute information visuelle. En 2024 , l’Académie des Technologies note un saut qualitatif inquiétant dans la crédibilité des informations truquées. Nous entrons dans une boucle où les Intelligences Artificielles apprennent à partir de fake news virales, créant une spirale de désinformation auto-renforçante. L’Intelligence Artificielle agit comme Hermès numérisé manipulant les groupes sociaux : démocraties fragilisées, marchés menacés, cohésion rompue.

Risques pour les sociétés : polarisation, radicalisation et effondrement du consensus de réalité

La polarisation médiatique réduit la confiance publique en nourrissant un doute constant envers les institutions et les faits partagés. Les algorithmes des réseaux sociaux enferment les usagers dans des bulles de filtres personnalisées, transformant les désaccords politiques en oppositions irréconciliables. Chaque camp finit par percevoir l’autre comme une menace existentielle pour ses valeurs fondamentales. Cette dynamique encourage la radicalisation progressive, car les contenus émotionnels extrêmes circulent six fois plus vite que les contenus modérés. Cela renforce les identités de groupe par inclusion et exclusion, préparant le terrain à des confrontations où le compromis n’est plus envisageable rationnellement.

L’affaiblissement des institutions accroît ces risques notablement. Un conflit violent n’en reste pas moins évitable. Une polarisation persistante provoque des troubles graves lorsque la légitimité d’un gouvernement vacille. Des émeutes urbaines, des blocages de routes ou des violences locales surgissent lorsque les citoyens rejettent l’autorité au nom de vérités parallèles.

Le chercheur David Betz estime que ce risque s’élève à environ 4% par an dans un pays comme la France, grimpant à 18,5% sur cinq ans à cause des fractures culturelles accumulées. Des institutions solides – justice indépendante, police impartiale, médias professionnels – permettent de canaliser ces tensions par médiation institutionnelle. Cependant, leur affaiblissement ouvre la porte à des crises où la rue remplace le vote comme arbitre ultime.

La désinformation devient dangereuse lorsqu’elle transforme les débats politiques en conflits sur la réalité même. Les acteurs ne discutent plus de solutions : ils contestent la validité des faits fondamentaux. L’accumulation de versions contradictoires d’un même événement (élections, pandémie, changement climatique) sème le doute et décourage les citoyens de vérifier les informations. Cela favorise l’indifférence apathique ou l’agressivité défensive. Dans ce contexte, une publication virale peut déclencher des émeutes en convainquant un groupe que l’État ment systématiquement. Cette rupture épistémique empêche la négociation rationnelle et laisse la place à la force brute comme seul langage commun.

La radicalisation s’accélère à cause des boucles de rétroaction algorithmique. Les plateformes récompensent l’indignation par plus de visibilité, poussant les discours vers l’extrémisme par sélection évolutionnaire. En France, la confiance envers les médias traditionnels n’est que de 37% (Edelman 2026), ce qui pousse les citoyens vers des sources partisanes alternatives. Les modérés s’isolent par fatigue cognitive et les extrêmes s’arment de récits de victimisation morale. Cette logique empêche le débat démocratique. Les mouvements sociaux récents (Gilets Jaunes, réforme des retraites) illustrent comment une tension initiale peut dégénérer en violence lorsque l’État ne parvient plus à proposer un récit commun.

Des troubles graves restent possibles sans institutions robustes. Des sabotages d’infrastructures ou des villes ingouvernables sont envisageables dans un scénario de perte de confiance généralisée. Le sentiment de déclassement économique forme un cocktail explosif avec la colère culturelle. Toutefois, une guerre civile généralisée demande une coordination logistique que les démocraties modernes fragmentées ne possèdent pas naturellement. La France illustre ce seuil critique avec des violences ciblées (banlieues, syndicats) qui affaiblissent la légitimité publique sans faire basculer le pays dans le chaos total. L’équilibre précaire repose sur la mémoire institutionnelle de 1789 et de la Résistance.

La désinformation s’appuie sur la solitude sociale et la précarité matérielle pour transformer la politique en une guerre de l’esprit. En 2025, le Forum Économique Mondial considère cela comme le risque majeur pour 2025-2030. Les fausses nouvelles saturent les réseaux et rendent les faits inaccessibles par bruit cognitif. Quand les deux camps ne partagent plus la même réalité ontologique, le dialogue disparaît par impossibilité épistémique. Les élections deviennent alors des batailles où la vérité perd toute autorité normative. Sans éducation critique dès l’enfance ou régulation des algorithmes, la société se fragmente en factions prêtes à l’affrontement physique. L’Europe observe déjà ce glissement où Hermès brouille la frontière entre le réel et l’illusion.

L’état algorithmique décrit par Asma Mhalla radicalise ces risques par fusion techno-étatique. Elle théorise un pouvoir hybride où les géants du numérique (Meta, X/Twitter, Musk) ne sont pas de simples intermédiaires, mais co-gouvernants de la réalité avec les États conservateurs. La polarisation devient alors architecturale : les bulles de filtres ne sont pas des effets secondaires indésirables, mais des fonctionnalités conçues pour maximiser l’engagement par colère, rendant le compromis structurellement impossible. Le « totalitarisme cyberpunk » que décrit Mhalla opère non par coercition brute, mais par consentement addictionnel – les citoyens s’y soumettent volontairement, séduits par la personnalisation et la validation constante. La surveillance est interne, par collecte de données comportementales ; la persuasion est algorithmique, par exposition ciblée ; le pouvoir est distribué entre Big Tech et Big State dans un Léviathan à deux têtes. Cette société fragmentée en réalités parallèles ne peut plus débattre car elle ne partage plus l’espace épistémique commun. Chaque bulle produit sa propre vérité, son propre récit, sa propre moralité – jusqu’à l’impossibilité de se reconnaître dans l’autre. Le numérique n’étend pas l’humain, il le soumet à une politisation cyberpunk où la technologie devient l’arme de la domination politique silencieuse.

Solutions et contre-offensive : éducation, régulation et hygiène informationnelle collective

Le renforcement de l’éducation aux médias constitue la première défense contre le mensonge systémique. En France, l’Éducation nationale propose des modules sur la vérification des sources depuis 2016 (EMI : Éducation aux Médias et à l’Information). Ce socle scolaire doit s’étendre aux adultes par des formations en entreprise pour aider les 20% de citoyens touchés par l’illettrisme numérique. L’objectif est d’activer le Système 2 par habitude : Enseigner la lecture critique de l’URL, du DOC, de l’auteur, du contexte. Des exercices pratiques de détection de manipulations (deepfakes, images recadrées) renforcent l’immunité cognitive. Le jeu sérieux « Bad News » (Roozenbeek & van der Linden, 2019) montre que l’inoculation par simulation réduit la crédulité de 30%.

Les procédures de vérification indépendantes, comme celles de l’ « AFP Factuel », « Misini » ou « Les Décodeurs du Monde », demandent une transparence totale sur les méthodes et les sources. Une norme européenne de labellisation, utilisant la technologie blockchain pour tracer l’origine des contenus (C2PA : Coalition for Content Provenance and Authenticity), permettrait de garantir la crédibilité technique. Ces outils aideraient les citoyens à valider les faits en temps réel afin de restaurer une base de connaissances commune minimale. Les plateformes doivent intégrer ces labels par défaut, non en option.

Il est nécessaire d’imposer des règles strictes aux plateformes pour éviter à la fois la censure arbitraire et l’impunité algorithmique. La loi française oblige déjà les hébergeurs à retirer les contenus illicites (haine, désinformation électorale) rapidement sous peine d’amendes jusqu’à 1,25% du chiffre d’affaires. Le règlement européennes sur les services numériques (DSA, 2024) étend ces obligations à la transparence algorithmique : Meta, X, TikTok doivent désormais publier leurs critères de modération et de recommandation. Des sanctions graduées protègent la liberté d’expression tout en limitant les abus systémiques. La Commission européenne a infligé à X une amende de 120 millions d’euros en décembre 2025 pour violations du Digital Services Act (DSA), première sanction historique de ce type. La France soutient cette décision et rappelle que la conformité aux obligations de transparence algorithmique est obligatoire.

La formation des citoyens passe aussi par des campagnes de sensibilisation simples et ludiques. Des applications mobiles permettent déjà de signaler les fraudes en ligne (Signal-conscious, Pharos).

Les étapes clés de la vérification s’enseignent par applications ludiques :

(1) contrôler la source originale (URL, domaine, auteur) ;

(2) croiser au moins trois sources fiables indépendantes ;

(3) vérifier la date et le contexte ;

(4) utiliser des outils de recherche d’image inversée comme Google Images, TinEye ou RevEye pour identifier les images détournées ;

(5) consulter les fact-checkers agréés (AFP Factuel, Les Décodeurs).

L’esprit critique se construit par l’habitude, pas par l’interdit. Ces solutions demandent une volonté politique forte pour surmonter la résistance des géants technologiques, qui préfèrent l’autorégulation.

L’Intelligence Artificielle peut aussi détecter les fake news par analyse de patterns (textes générés, incohérences stylistiques, sources invisibles). Des outils comme IsItAI ou Hive Moderation atteignent 85-90% de précision pour les images. Cependant, cette course aux armements tourne en spirale : les générateurs s’améliorent plus vite que les détecteurs. La solution n’est pas technique pure, mais hybride : Intelligence Artificielle associée à une vérification humaine et une éducation citoyenne. L’Académie des Technologies recommande une « hygiène de l’information » collective : pauses de vérification avant partage, ralentissement volontaire du Système 1.

Prospective : vers une ère où la simulation devient la seule réalité perçue

À l’avenir, la frontière entre l’information, la persuasion et la simulation risque de s’effacer complètement. Les outils de création de contenus et la réalité augmentée rendent la distinction de plus en plus difficile pour le cerveau non entraîné. Un discours politique pourra être réel ou synthétisé par une machine en temps réel, ce qui rendra la confiance spontanée impossible par défaut. Cette fusion transforme les échanges en champs de bataille cognitifs où la vérité objective laisse la place à des réalités construites sur mesure pour chaque individu.

L’intelligence artificielle devient un nouvel Hermès numérisé qui génère des contenus indiscernables du réel pour chaque utilisateur. Les algorithmes guident désormais l’utilisateur dans une simulation adaptée à ses propres biais, préférences et traumatismes. Cette persuasion se fait sans laisser de traces conscientes, de sorte que le récepteur ignore s’il est informé ou manipulé. Cela dissout la rationalité collective au profit de petites réalités fragmentées et incommunicables. La vérité devient personnelle, non partagée.

L’enjeu devient alors anthropologique et existentiel. Selon McLuhan, l’être humain est un prolongement de ses outils. Dans un monde médiatisé en permanence, la pensée s’externalise vers des agents Intelligence Artificielle conversationnels. Cela fragmente l’attention et l’identité continue du soi. Le soi devient multiple, car il est recomposé par des récits numériques personnalisés. Quand la simulation fabrique le quotidien, l’humain perd son lien avec le monde physique partagé. La perception du temps et de l’espace change radicalement, ce qui interroge sur la définition même de l’humanité dans l’ère post-numérique.

La réalité fabriquée abîme l’identité authentique par simulation permanente. Les réseaux sociaux créent des doubles numériques où l’intimité est mise en scène en permanence pour l’audience. L’individu se projette dans des performances simulées jusqu’à perdre son noyau authentique par aliénation progressive. Cette présence constante de la technologie transforme les civilisations par modification des rythmes biologiques et sociaux. Nous passons d’une culture de masse homogène à des bulles hyper-personnalisées où la relation avec l’autre est filtrée par des machines avant même d’être vécue.

Une reconstruction est possible grâce à une hygiène de l’information disciplinée. Cela passe par une éducation critique dès l’enfance et des normes de traçabilité obligatoires pour les contenus générés par des machines (Watermarking IA). Les sociétés doivent imposer des pauses cognitives pour la vérification afin de freiner l’émotion du Système 1 au profit de la raison du Système 2. L’intelligence artificielle doit être traitée comme une muse inspirante et non comme un oracle indiscutable. La méfiance systématique envers le flux immédiat devient une vertu civique.

Sans cette discipline collective, la fragmentation s’installera durablement dans les décennies à venir. Des groupes isolés vivront chacun leur vérité incommunicable, ce qui mènera à une société divisée en réalités parallèles. Les conflits sur la réalité provoqueront des violences physiques et l’État perdra son rôle de garant du récit national unificateur. L’allégorie de la caverne de Platon s’inverse alors : les ombres ne trompent plus, elles deviennent la seule réalité perçue par les prisonniers modernes. L’humanité se retrouve piégée dans une illusion qu’elle alimente elle-même par addiction algorithmique.

Deux trajectoires s’opposent pour le futur des démocraties : la maturité cognitive ou le déclin épistémique. Les sociétés qui développent des réflexes collectifs de vérification et d’éducation permanente parviendront à une meilleure résilience face à l’hyper-Hermès. Celles qui s’abandonnent à la persuasion fluide risquent de sombrer dans une ère où la pensée et la vérité se dissolvent par saturation.

En 2030, l’identité entre l’humain et la machine pourrait redéfinir la persuasion politique elle-même. Une piste optimiste mais fragile propose de former des citoyens capables de distinguer la forme du fond dans un océan de simulations personnalisées. Or, l’histoire humaine montre que les biais cognitifs sont profondément ancrés biologiquement, et que les gains de lucidité collective sont rares face à l’addiction dopaminergique immédiate. Sans une volonté politique contraignante (régulation algorithmique, éducation précoce, sanctions coercitives), la réalité fabriquée triomphera sur l’être authentique par sélection évolutionnaire des bulles les plus addictives — conduisant à une fragmentation démocratique durable, voire à des violences politiques localisées. L’Europe observe déjà ce glissement où Hermès brouille la frontière entre le réel et l’illusion.

Conclusion : Hermès et le médium — l’analogie fondamentale entre messager ancien et loi médiatique

L’analogie entre Hermès et le principe de McLuhan « le médium est le message » résume l’ensemble de cette analyse. Hermès n’était pas un simple messager passif transmettant mot pour mot les ordres divins : il les reformulait par ruse, les adaptait au destinataire, les transformait par éloquence. Son rôle était transformateur, pas transporteur. De même, McLuhan démontre que le médium numérique n’est pas un canal neutre transportant des informations intactes : il modèle, amplifie, personnalise et déforme le contenu par sa structure même. Les sandales ailées d’Hermès préfigurent la vitesse algorithmique qui distord le message original par accélération ; le caducée entrecroisé préfigure l’ambivalence des technologies à la fois guérison et poison.

Le principe gouvernant est le suivant : la communication n’existe pas sans transformation. Hermès « personnifie » l’intermédiaire actif qui modifie autant qu’il transmet ; McLuhan formalise cette loi en montrant que le canal restructure les sens et la société plus que le contenu. Les fake news prospèrent précisément parce que le médium numérique (réseaux sociaux, Intelligence Artificielle) sélectionne l’émotion sur la vérité, la vitesse sur la vérification, la viralité sur l’exactitude – comme Hermès préfère la ruse persuasive à la lettre brute. L’effet Dunning-Kruger complète cette vision : les citoyens surestiment leur capacité à résister à la transformation herméenne, croyant discerner la vérité alors qu’ils sont piégés par la forme du médium. Asma Mhalla radicalise l’analogie : l’État algorithmique contemporain est un Hermès collectivisé et automatisé, transformant les citoyens en soldats inconscients de propagande par personnalisation addictive.

En définitive, Hermès et McLuhan convergent vers une même vérité anthropologique : nous ne communiquons jamais avec des faits bruts, toujours avec des réalités médiatisées et transformées par le canal. La question éthique n’est pas d’éliminer cette transformation – impossible – mais de la rendre consciente par éducation critique, transparence algorithmique et hygiène informationnelle collective. Sans cette lucidité, nous restons des prisonniers de la caverne inversée, croyant voir le réel alors que nous ne voyons que les ombres forgées par nos propres outils.

Bibliographie Sélective

I. Sources antiques et fondations mythologiques

HOMÈRE. Hymne homérique à Hermès (VIème siècle B.C.). Traduit par Jean HUMBERT. Paris : Les Belles Lettres, coll. « Budé », 1936 (rééd. 2002). 75 p.

HOMÈRE. Iliade (VIIIème siècle B.C.). Traduit par Paul MAZON. Paris : Les Belles Lettres, coll. « Classiques en poche », 1998. 1126 p.

HOMÈRE. Odyssée (VIIIème siècle B.C.). Traduit par Victor BÉRARD. Paris : Le Livre de Poche, coll. « Classiques », 1973. 544 p.

HÉSIODE. Théogonie (VIIIème siècle B.C.). Traduit par M. LEJBOWICZ. Paris : Les Belles Lettres, 1999. 256 p.

PLATON. Gorgias (env. 380 B.C.). Traduit par Monique CANTO-SPERBER. Paris : Flammarion, coll. « GF », 2007. 338 p.

SUN TZU. L’Art de la guerre (VIème siècle B.C.). Traduit par Jean LEVI. Paris : Hachette Littératures, coll. « Pluriel », 2000. 224 p.

II. Théories des médias et de la communication

INNIS, Harold Adams. Empire and Communications. Victoria : University of Victoria Press, 1950. Rééd. Toronto : University of Toronto Press, 1972. 184 p.

McLUHAN, Marshall. Pour comprendre les médias : les prolongements technologiques de l’homme. Traduit par Jean PARÉ. Paris : Robert Laffont, coll. « Les Chemins de la connaissance », 1968. 350 p. Titre original : Understanding Media: The Extensions of Man. New York : McGraw-Hill, 1964.

McLUHAN, Eric ; ZINGRONE, Frank (dir.). Essential McLuhan. New York : Basic Books, 1995. 432 p.

POSTMAN, Neil. Se distraire à en mourir. Traduit par Isabelle PINEAU. Paris : Flammarion, coll. « Champs essais », 1986. 243 p. Titre original : Amusing Ourselves to Death. New York : Viking Penguin, 1985.

RICOEUR, Paul. Soi-même comme un autre. Paris : Éditions du Seuil, coll. « L’Ordre philosophique », 1990. 432 p. ISBN 978-2-02-011458-5.

III. Technopolitique et état algorithmique

MHALLA, Asma. Technopolitique : Comment la technologie fait de nous des soldats. Paris : Éditions du Seuil, 2024. 320 p. ISBN 978-2-02-153812-3.

MHALLA, Asma. Cyberpunk : Le nouveau système totalitaire. Paris : Éditions du Seuil, 2025. 384 p. ISBN 978-2-02-154389-9.

IV. Théorie de l’information et cybernétique

SHANNON, Claude E. ; WEAVER, Warren. La Théorie mathématique de la communication. Traduit par Jean COSNIER, Cathérine KERBRAT-ORECCHIONI et Gilles DAHAN. Paris : Retz, coll. « Les Classiques des sciences humaines », 1975. 188 p. Titre original : The Mathematical Theory of Communication. Urbana : University of Illinois Press, 1949.

WIENER, Norbert. Cybernétique et société : L’usage humain des êtres humains. Traduit par Paul-Yves MISTOU et Jean-Paul VALLÉE. Paris : Éditions du Seuil, coll. « Points Sciences », 1952 (rééd. 2014). 246 p. Titre original : Cybernetics: Or Control and Communication in the Animal and the Machine. New York : John Wiley & Sons, 1948.

V. Sciences cognitives, psychologie sociale et mémétique

ASCH, Solomon E. « Effects of group pressure upon the modification and distortion of judgments ». In GUETZKOW, Harold (dir.). Groups, Leadership and Men: Research in Human Relations. Pittsburgh : Carnegie Press, 1951, pp. 177-190.

BLACKMORE, Susan. The Meme Machine. Oxford : Oxford University Press, 1999. 288 p. ISBN 978-0-19-286212-9.

BLOOM, Howard. Le Principe de Lucifer : Une expédition scientifique dans les forces de l’histoire. Traduit par Anne BÉNASSY. Paris : Le Jardin des Livres, 2001. 464 p. ISBN 978-2-914569-03-3. Titre original : The Lucifer Principle: A Scientific Expedition Into the Forces of History. New York : Atlantic Monthly Press, 1995.

DAWKINS, Richard. Le Gène égoïste. Traduit par Laura OVION. Paris : Odile Jacob, 1996. 497 p. ISBN 978-2-7381-0228-3. Titre original : The Selfish Gene. Oxford : Oxford University Press, 1976.

DUNNING, David ; KRUGER, Justin. « Unskilled and Unaware of It: How Difficulties in Recognizing One’s Own Incompetence Lead to Inflated Assessments ». Journal of Personality and Social Psychology, 1999, vol. 77, n° 6, pp. 1121-1134.

FAZIO, Lisa K. ; BRASHIER, Nadia M. ; PAYNE, B. Keith ; MARSH, Elizabeth J. « Knowledge Does Not Protect Against Illusory Truth ». Journal of Experimental Psychology: General, 2015, vol. 144, n° 5, pp. 993-1002.

KAHNEMAN, Daniel. Système 1 / Système 2 : Les deux vitesses de la pensée. Traduit par Raymond CLARINARD. Paris : Flammarion, coll. « Essais », 2012. 555 p. ISBN 978-2-08-121147-6. Titre original : Thinking, Fast and Slow. New York : Farrar, Straus and Giroux, 2011.

KAHNEMAN, Daniel ; TVERSKY, Amos. « Availability: A Heuristic for Judging Frequency and Probability ». Cognitive Psychology, 1973, vol. 5, n° 2, pp. 207-232.

NICKERSON, Raymond S. « Confirmation Bias: A Ubiquitous Phenomenon in Many Guises ». Review of General Psychology, 1998, vol. 2, n° 2, pp. 175-220.

PENNYCOOK, Gordon ; RAND, David G. « Lazy, Not Biased: Susceptibility to Partisan Fake News Is Better Explained by Lack of Reasoning Than by Motivated Reasoning ». Cognition, 2019, vol. 188, pp. 39-50.

VI. Désinformation, fake news et viralité

ROOZENBEEK, Jon ; VAN DER LINDEN, Sander. « The Fake News Game: Actively Inoculating Against the Risk of Misinformation ». Journal of Risk Research, 2019, vol. 22, n° 5, pp. 572-593.

VOSOUGHI, Soroush ; ROY, Deb ; ARAL, Sinan. « The Spread of True and False News Online ». Science, 9 mars 2018, vol. 359, n° 6380, pp. 1146-1151.

VII. Conflits, guerre de l’information et risques géopolitiques

BETZ, David. The New Art of War: Contested Reality and the Real War on Facts. London : Routledge, 2021. 240 p. ISBN 978-0-367-46686-2.

VIII. Rapports institutionnels et documents officiels

ACADÉMIE DES TECHNOLOGIES. Rapport sur l’évolution des risques liés à l’intelligence artificielle générative et à la crédibilité de l’information. Paris : Éditions de l’Académie des Technologies, 2024. 120 p.

C2PA — COALITION FOR CONTENT PROVENANCE AND AUTHENTICITY. Technical Specification 2.1. 2023. Disponible en ligne : https://c2pa.org

COMMISSION EUROPÉENNE. Digital Services Act (DSA) — Implementation Report. Bruxelles : Publications de l’Union européenne, 2024. 200 p.

EDELMAN. Edelman Trust Barometer 2026. San Francisco : Edelman, janvier 2026. 150 p. Disponible en ligne : https://www.edelman.com/trust

FORUM ÉCONOMIQUE MONDIAL. Global Risks Report 2025 : 20ème édition. Genève : World Economic Forum, janvier 2025. 100 p. Disponible en ligne : https://www.weforum.org

OCDE. Trust in Public Institutions 2023. Paris : OCDE Éditions, 2023. 180 p. DOI : 10.1787/b407f99c-en.

PEW RESEARCH CENTER. Public Trust in Information and the Rise of AI. Washington D.C. : Pew Research Center, février 2025. 85 p. Disponible en ligne : https://www.pewresearch.org

IX. Ressources et outils de vérification (sitographie)

AFP FACTUEL. Méthode de vérification des faits. Paris : Agence France-Presse, 2026. Disponible en ligne : https://factuel.afp.com

ISITAI. AI-Generated Content Detector. 2025. Disponible en ligne : https://isitai.com

LES DÉCODEURS. Guide de vérification. Paris : Le Monde, 2026. Disponible en ligne : https://www.lemonde.fr/les-decodeurs

MINISTÈRE DE L’INTÉRIEUR (France). Signal-Conçu : Application de signalement de contenus illicites en ligne. Paris : Ministère de l’Intérieur, 2025. Disponible en ligne : https://www.internet-signalement.gouv.fr